Table of Contents

Multilayer

http://www.willamette.edu/~gorr/classes/cs449/multilayer.html

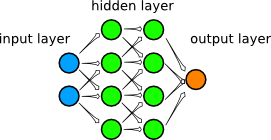

Nella seguente figura è mostrata una rete composta da due strati di neuroni (hidden layer, in verde).

Le reti neurali con uno o più hidden layer con più neuroni, sono anche non lineari

Quindi forniranno come soluzione l'imitazione di funzioni non lineari.

Abbiamo visto che i pesi sinaptici nelle reti lineari si possono calcolare analiticamente perché la soluzione è lineare. Ad esempio, usando la regressione lineare, poiché la funzione errore quadratico medio è (in tal caso) quadratica, essa è facilmente derivabile e si trova facilmente il minimo errore rispetto ai pesi sinaptici.

Nelle reti non lineari per minimizzare l'errore quadratico medio si devono usare, invece, tecniche di iterazione numerica:

Applicando un algoritmo gradient descent alle reti neurali si ottiene il metodo Backpropagation

?

Quanti hidden layer servono per un certo problema di imitazione?

- ne basta uno!

Quanti neuroni per ogni layer?

- con un neurone su un hidden layer si ottiene una imitazione della stessa funzione di attivazione

- con due neuroni su un hidden layer si ottiene una imitazione della somma dei grafici di due funzioni di attivazione

- ecc.

NOTA: Attenzione a non esagerare con il numero di neuroni : problema overfitting

Bias unit

Sia nelle reti single layer che multi layer, ci sono un quarto tipo di neuroni (o unità neurali) (oltre ai tre già visti: input, hidden e output):

- bias unit

Essi generano un output costante pari ad uno, ed hanno un proprio peso sinaptico.

Esiste un bias unit per ogni neurone che non appartiene all'input layer, quindi ce ne sono molti, ma solitamente sono omessi nello schema neurale, come sott'intesi.